"التزييف العميق" أخطر وأسهل من أي

برامج تعديل على الفيديو على مر العصور!!

هذه هي المقالة الثالثة عن موضوع

" التزييف العميق "

أحبائنا متابعي مجلة حياتي

كثر الحديث مؤخرا في معظم قنوات التلفزة

والمواقع الإخبارية وصولا إلى مواقع

التواصل الاجتماعي عن تقنية التزييف العميق هذه.

ولا نعلم إن كانت هذه حملة دعائية لإشهار هذه

التقنية أو لأي سبب آخر نعلمه أو نجهله.

وغاية أملنا هي التوعية العامة من مثل هذه الأمور.

ولزيادة الشرح والتوضيح جمعنا لكم بعض المعلومات

من هنا وهناك، لنقدم لكم التقرير التالي.

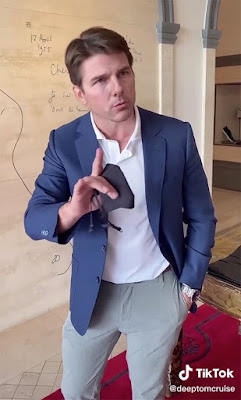

فقد حققت سلسلة من مقاطع الفيديو،

التي تم إعدادها بتقنية التزييف العميق

" DeepFake "

للنجم الأميركي توم كروز، ملايين المشاهدات على

منصة "تيك توك" منتصف الأسبوع الماضي،

بحسب ما ذكرته صحيفة

"نيويورك بوست" New York Post ".

واعتبر الخبراء سلسلة المقاطع المزيفة الأخيرة أحد أكثر

الأمثلة الواقعية المثيرة للقلق حتى الآن جراء الآثار

السلبية لخدعة التكنولوجيا الفائقة

حيث وصف بروفيسور هاني فريد، الأستاذ بجامعة

كاليفورنيا في بيركلي، مقاطع الفيديو بأنها تم إعدادها

بإتقان "بشكل لا يصدق"، وهو نفس رأي خبراء آخرين

أدلوا بتصريحات مماثلة لمجلة "فورشن" الأميركية.

كما غردت راشيل توباك، الرئيس التنفيذي لشركة

"سوشيال بروف" للأمن عبر الإنترنت،

قائلة إن مقاطع الفيديو أثبتت أن الأمر وصل إلى مرحلة

من التزييف العميق الذي لا يمكن اكتشافه تقريبًا.

وأضافت أنه "لمجرد تصور أن الشخص يمكنه تحديد

الفرق بين الوسائط التركيبية والأصلية بشكل فردي،

فإنه لا يعني أن الأمور على ما يرام".

وقالت توباك: "ستؤثر تقنية التزييف العميق على ثقة

الجمهور وتوفر غطاءً وإنكارًا معقولاً للمجرمين أو المسيئين

الذين يتم ضبطهم من خلال تسجيل مقاطع فيديو أو صوت،

كما أنه سيمكن أن يتم استخدامها للتلاعب بالآخرين

وإذلالهم وإيذائهم" أو ابتزازهم.

وشرحت توباك أن تقنية التزييف العميق يمكن استغلالها

بشكل سلبي وخطير للتأثير السياسي وهو ما سيضر

بالمجتمعات ككل، مناشدة شركات التكنولوجيا

بسرعة الانتهاء من ابتكار تقنيات "للكشف عن الوسائط

الاصطناعية أو [مقاطع الفيديو] المُتلاعب بها".

وفي تقرير نشرته مجلة

"سايبر سيكيورتي Ciber Security " الأميركية،

وأعدته كاليب تاونسيند، تم إبراز أن معدلات تداول

مقاطع الفيديو تشهد نموًا متزايدًا مع استمرار السماح

بتوزيع برامج كمبيوتر وتطبيقات إلكترونية للتزييف العميق.

أسهل من "فوتوشوب"

وحذر التقرير من أن إنشاء مقاطع الفيديو المزيفة

بات من أسهل الممارسات، مثل برامج فوتوشوب لتحرير

وإدخال تعديلات على الصور الفوتوغرافية،

موضحًا أن السبب يرجع إلى تزييف مقاطع الفيديو يعتمد

إلى حد كبير على تقنية التعلم الآلي بدلاً من مهارات

التصميم اليدوي، علاوة على أن مثل هذه البرامج

والتطبيقات تكون عادةً بما يجعله في متناول الكثير

من المستخدمين العاديين.

إن أكثر عواقب عمليات التزييف العميق خطورة هي

قدرتها على جعل الجمهور العادي يتساءل عما يراه،

وكلما زادت مقاطع الفيديو المزيفة قل الثقة في

التمييز بين الحقيقي والمزيف.

وتقول تاونسيند إن من المؤكد أن التلاعب بالفيديو

ليس بالأمر الجديد على الإطلاق. كان الناس يتلاعبون

بمقاطع الفيديو لخداع الجماهير للاعتقاد بأن شيئًا ما

حقيقي منذ ظهور الفيلم. ولكن أدخلت تقنية

التزييف العميق مستوى جديدًا من الدقة في المعادلة.

لقد أصبح من الصعب أكثر من أي وقت مضى معرفة

الفرق بين مقاطع الفيديو المزيفة هذه

والمقاطع الحقيقية.

ولا شك في أن عدم القدرة على اكتشاف التزييف

العميق سيستخدم في عدد من الأغراض الشريرة

أو الإجرامية بهدف تقويض الحقيقة والعدالة

ونسيج المجتمعات.

وفي عالم اليوم الذي يمتلئ بمنصات التواصل الاجتماعي

والمواقع والصفحات والتطبيقات الإلكترونية المتنوعة،

يزداد احتمال وقوع الأشخاص ضحية لتضليل أو

استقطاب بخاصة عندما يتم دمج مقطع فيديو مزيف

إلى سلسلة من الأكاذيب أو الأخبار الوهمية.

وبالتالي، يمكن لهذا التضليل أو التلاعب التأثير على

الرأي العام من خلال استهداف شخصيات سياسية

بإنشاء لقطات مزيفة لهم وهم يقولون أشياء

لم ترد على ألسنتهم قط، أو يرتكبون أفعالا لم يتم

اقترافها من قبل.

سيتم القصف والتشهير بالمشاهير والقادة وأصحاب

الشركات والمرشحين للرئاسة والشخصيات الدينية

وقادة الفكر والثقافة وغيرهم باستخدام تقنية

" التزييف العميق " DeepFake "

على مدار السنوات القادمة، في حين سيقع على عاتق

المواطن العادي أن يميز بنفسه بين

ما هو حقيقي أو مزيف.

ومن المحتمل جدًا أن يتم الادعاء من جانب أي شخص

مشهور أو غير معروف يتعرض لفضيحة عامة بقول:

" لقد كنت ضحية فيديو مزيف عميق مستهدف ".

ويشير تقرير "سايبر سيكيورتي" إلى أن الأرقام المخزية

التي تدعي أن مقطع فيديو حقيقي مزيف هو سيناريو

معقول للغاية. مع عدم وجود أي دافع أخلاقي

يمنع الجهات السيئة من استغلال نقاط الضعف في

قدرة الإنسان على فك تشفير المحتوى المزيف.

إن مصداقية الشخصيات العامة ليست مكمن الخطر الوحيد

الناجم عن التزييف العميق، ففي الواقع،

يوجد مجموعة متنوعة من الطرق التي يمكن أن

تتسبب بها مقاطع الفيديو المزيفة في إحداث أضرار.

وفي المرحلة الحالية، لا يزال من السهل معرفة

ما إذا كان الفيديو مزيفًا بتقنية " التزييف العميق "

وتعتبر حركات الفم غير الطبيعية إلى حد ما والظلال

غير المتناسقة أو المنطقية وعدم وجود وميض للعين

من المؤشرات الشائعة التي يتم من خلالها تبين أن

مقطع الفيديو ليس حقيقيًا.

ولكن وبالتأكيد سيتم تطوير وتحسين تقنية التزييف

مع مرور الوقت.

لذا يجب على مطوري التكنولوجيا

الإسراع بإنشاء أنظمة تقفي وكشف للتزييف

مثل تلك المستخدمة في مختبرات الطب الشرعي،

على غرار طريقة التثبت من تزييف الصور الفوتوغرافية

عبر عدد وحدات البكسل المستخدمة.

كما يمكن تطوير مصنفات التعلم العميق، التي يمكنها

توظيف الذكاء الاصطناعي لفحص الميزات الأولية

لمقاطع الفيديو للإشارة إلى مدى أصالتها عبر العلامات

المائية للفيديو البيومتري، على الرغم من أنه يبدو أن

السباق سيكون طويلًا وشاقًا لأنه سيمكن أيضا

تدريب برامج تعلم آلي لتخطي وتجنب

مثل هذه الأدلة الجنائية.

المصدر: مواقع إلكترونية